数据越多,决策真的更容易吗?

直觉上,答案似乎是肯定的:信息越充分,判断越准确。

但在越来越多的真实场景中,情况却恰恰相反——数据越多,决策反而越难。

这并不是一个偶发现象,而是一个正在被忽视的结构性问题。

随着生成式AI的发展,数据的角色正在发生变化。它不再只是分析的输入,而正在逐渐进入决策过程本身。AI也从“辅助分析工具”,转向“参与决策生成的机制”。

但问题恰恰出现在这里:

虽然数据与AI能力不断增强,决策并没有同步变得更简单,反而变得更加复杂、不确定,甚至更难被信任。

这说明,问题并不在于“数据不够”。

如果把传统的数据使用过程进行抽象,可以得到一条熟悉的路径:

数据 → 分析 → 决策 → 行动

在这个逻辑中,决策的难度主要取决于分析能力—— 数据越多,分析越充分,决策应当越容易。

但在新的技术与应用环境下,这条路径正在悄然改变:

数据 → 决策前判断 → 分析/AI → 决策 → 行动

真正增加复杂度的,不再是分析过程,而是一个过去几乎被忽略的环节:

数据在进入分析之前,是否可以被使用,以及如何被使用。

这一变化,在不同领域的表现并不相同。

在低约束、低风险的场景中,更多数据与更强分析能力,确实仍然可以带来效率提升;

但在高复杂、高约束的领域(如医疗、金融),情况正在发生根本性转变。

在这些场景中,数据不仅是技术问题,更是规则问题、责任问题与边界问题的综合体现。

数据越多,并不意味着可用信息越多,反而意味着:

更多的数据来源需要被判断其合法性与适用性

更多的数据关系需要被厘清其语义与上下文

更多的使用路径需要被约束其权限与责任

结果是:决策的难度,从“如何分析数据”,转移到了“如何决定哪些数据可以被使用”。

可以预见,这一变化将带来明显的分化:

仅提供数据存储或简单分析能力的平台,将逐步边缘化

无法解释数据来源与使用路径的系统,将难以进入关键决策链条

缺乏可验证机制的AI输出,将难以在高价值场景中被长期信任

换句话说,数据本身不再构成优势,对数据的“使用控制能力”,正在成为新的分界线。

在这样的背景下,一种新的能力结构正在逐渐浮现,可以被理解为:

“数据使用前决策层”

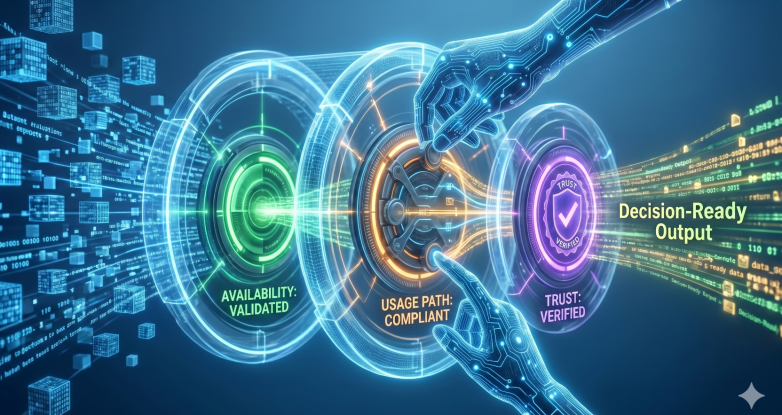

这一层并不直接参与分析,而是定义三件更基础的事情:

数据可用性判断:数据是否具备进入分析的条件

使用路径定义:数据在何种规则与约束下被调用与处理

结果可信性保障:输出是否具备可追溯与可验证能力

这三者共同构成了一个新的判断体系:

不是“如何用数据”,而是“是否允许数据被用,以及如何被用”。

在国内,已有少数团队开始尝试将这一能力进行产品化与平台化探索,并在部分真实业务场景中验证其可行性。

如果说过去的竞争在于“谁拥有更多数据”,

那么未来的分界线将逐渐转向:

谁在数据被使用之前,定义其可用性与使用路径。

数据不会消失,分析能力也不会消失,

但真正决定价值的,将不再是“谁更会用数据”,

而是——

在数据被使用之前,谁定义了它是否可以被使用,以及如何被使用。

本文采摘于网络,不代表本站立场,如有侵权,请联系删稿。转载联系作者并注明出处:http://www.china-datacenter.com/show-1514.html